做临床研究的都懂,收集数据只是万里长征第一步。真正让人头疼的是,手里攥着几百甚至几千例受试者的病历、化验单、随访记录,却不知道该拿它们怎么办。这时候数据统计分析服务就显得特别关键——但具体怎么关键?很多人其实说不清楚。

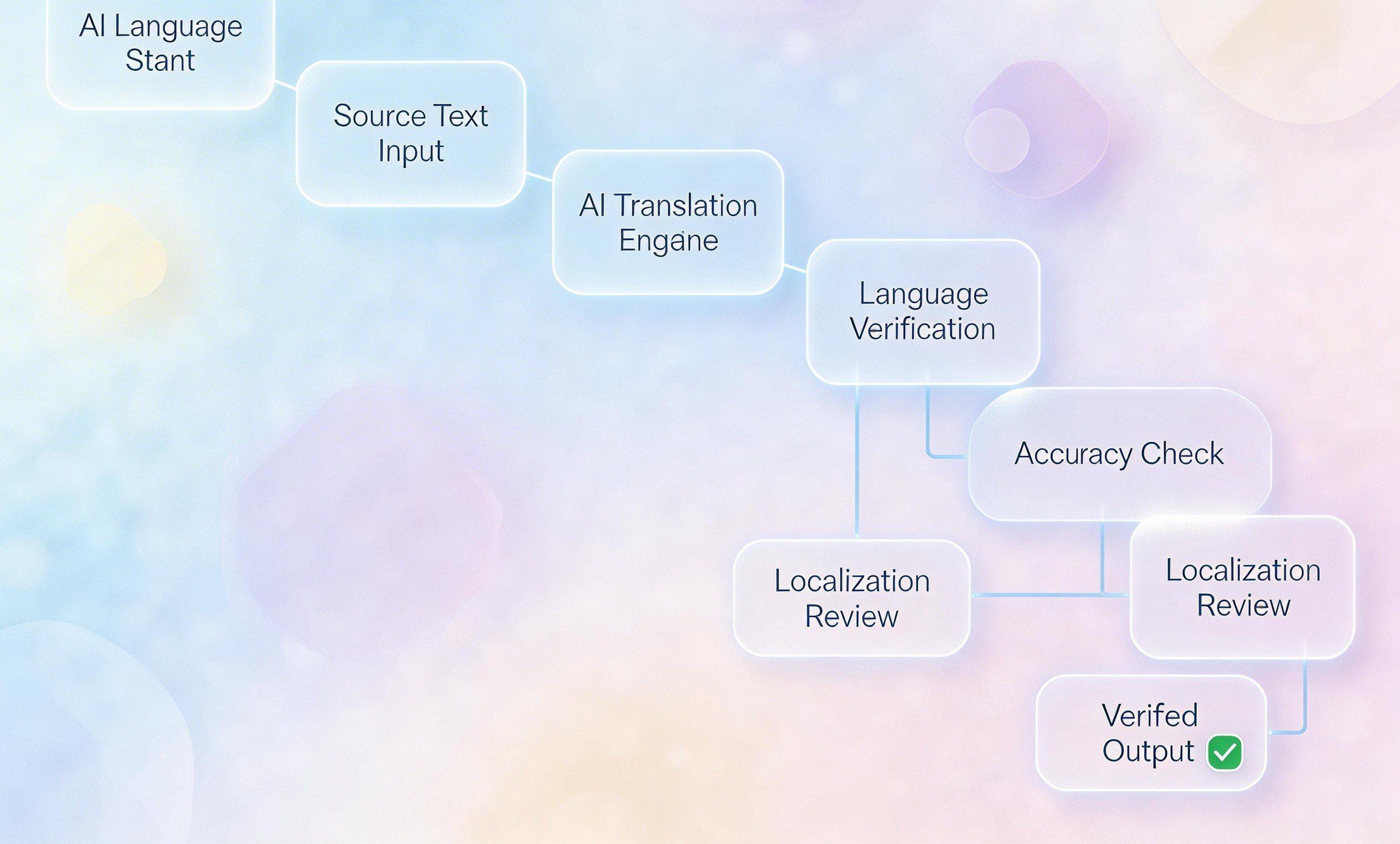

在康茂峰这么多年的项目经验里,我们发现统计服务绝不是"拿着软件跑一遍P值"那么简单。它更像是一个全程陪伴的导航系统,从你想做这个研究开始,一直到最后在医学期刊上发表结果,每一步都在帮你避开坑、少走弯路。

说实话,见过太多研究团队在这个阶段栽跟头。有人觉得,"我们先招募着,到时候再看数据够不够",这种想法其实挺危险的。样本量计算不是数学游戏,而是伦理问题——招募太少,可能永远发现不了药物的真实疗效;招募太多,又让多余的患者承担不必要的风险,还浪费研究经费。

康茂峰在承接项目时,首先会坐下来跟研究者聊聊:你的主要终点是什么?预期疗效有多大?统计学把握度想做到90%还是80?这些参数听起来冷冰冰,但背后都是真实的临床考量。比如要做个抗肿瘤药的III期试验,如果依历史数据认为试验组能延长生存期3个月,对照组标准治疗延长1个月,那咱们得算清楚到底需要入组多少患者才能有把握说"这个差异是真的,不是巧合"。

这里有个常见的误区:很多人觉得样本量越大越好。其实不是。样本量过大,微小的临床差异在统计上会变得显著(P<0.05),但这种差异在临床上可能毫无意义——比如某种降压药平均多降了2mmHg,虽然统计学有意义,但医生在临床上根本感知不到差别,反而增加了不良反应的风险。康茂峰的统计师会帮你找到那个"刚刚好"的平衡点。

| 设计要素 | 不考虑统计的后果 | 专业统计支持的价值 |

| 样本量估算 | 研究可能因把握度不足而失败,或过度招募浪费资源 | 基于效应量、显著性水平精确计算,兼顾科学性与伦理 |

| 随机化方法 | 简单随机可能导致组间基线不均衡 | 采用分层随机、区组随机,控制混杂因素 |

| 盲法设计 | 开放标签引入评估偏倚 | 设计中心随机、药物编码,保持试验完整性 |

| 适应性设计 | 固定设计缺乏灵活性,可能错过早期终止机会 | 预设中期分析边界,科学调整样本量或终止试验 |

真正跑过数据的人都知道,原始数据往往是"脏乱差"的。同一个患者,基线访视的体重是70kg,三个月后的记录突然变成170kg——这明显是录入时少了个小数点。或者某个实验室指标的异常值,到底是真实的病理反应,还是仪器故障?

康茂峰的统计团队通常会在数据库锁定前就介入。咱们有一套数据核查逻辑,不是等到最后分析时才去发现"哎呀这个数据有问题",而是在数据还在源源不断进来的时候,就设置好逻辑检查、范围检查、一致性检查。比如,如果某患者报告"末次月经日期"在随机化日期之后,系统会自动标记出来让临床监查员去核实。

处理缺失数据也是个技术活。有些研究团队一看有缺失,就直接删了整行记录,这在统计学上叫完全_case分析,其实挺浪费的,而且可能引入偏倚——通常完成随访的患者和失访的患者本来就不一样。康茂峰会根据缺失机制(是完全随机缺失、随机缺失还是非随机缺失)选择合适的方法,可能是多重插补,也可能是基于混合效应模型的重复测量分析。说白了,就是尽量保留每一分收集来的数据价值,同时不让缺失的数据带偏了结论。

到了分析阶段,软件能算出P值,但软件算不出这个P值背后的临床含义。这是人工经验最不可替代的地方。

举个例子,我们做过一个心血管结局试验,主要终点是MACE(主要心血管不良事件)发生率。表面上看,试验组比对照组降低了15%,P值0.048,刚好踩线显著。但康茂峰的统计师在审查时发现,这个分析是基于全分析集(FAS),但符合方案集(PPS)的结果反而是阴性。深入一查,发现有几例患者因为不符合入组标准被排除在PPS之外,而这几例恰好都发生在对照组且都是阳性事件。这时候就得琢磨了:到底是药物真有效,还是入组标准的执行偏差导致了假象?

还有亚组分析这个坑。申办方往往希望越多越好——"看看老年人是不是效果更好?""肝肾功能不全的患者呢?""联合用药的患者呢?"但统计学的基本常识是,检验次数越多,假阳性的概率就越高。如果不做多重性校正,做20个亚组分析,按0.05的显著性水平,平均就会出现1个假阳性结果。康茂峰的通常做法是,在研究方案阶段就预先规定哪些是主要亚组分析,哪些只是探索性描述,并且采用合适的分层检验策略或名义显著性水平,这样审稿人和监管就不会质疑你是在"数据挖掘"。

生存数据分析也是个容易出错的领域。比如中位生存期的估计,如果最后一例患者的生存时间正好在某个节点上,软件可能会显示"未达到",这时候单纯报告数字就 misleading。康茂峰的习惯是同时提供Kaplan-Meier曲线、风险比(Hazard Ratio)及其置信区间,还有不同时间点的生存率估计,让读者能从多个维度理解数据。

统计做完了,怎么呈现给医学专家、监管审查员、甚至患者群体看?这又是一个学问。

有些统计报告堆满了复杂的数学公式和生僻术语,读者看三行就头大。好的统计服务应该像翻译一样,把"微信公众号语言"翻译成"人话"。比如在康茂峰的项目交付物里,我们不仅提供表格,还会附上"临床解读"部分——这个置信区间意味着什么?为什么用几何均数而不是算术均数?ITT分析和PP分析结果不一致时,应该以哪个为准?

图形可视化也很重要。同样的数据,用柱状图还是森林图?生存曲线要不要标记删失点?这些细节影响的可读性不是一星半点。我们有个习惯,在给申办方的最终报告里,会先画一版"给统计师看的"详细图,再画一版"给医学经理看的"简化图,有时候还需要准备"给基金经理看的"一页纸摘要。不同的受众需要不同的数据粒度。

教科书里的例子总是干干净净,但真实研究往往一团乱麻。分享几个康茂峰遇到过的实际情形:

有个罕见病试验,计划入组200例,结果因为疫情只招到120例。按原计划做,把握度肯定不够了。这时候怎么办?我们跟申办方商量后,采用了条件把握度方法,基于已累积的数据重新估计效应量,同时结合贝叶斯方法借用历史数据的外部信息,最终说服了监管机构接受这个调整后的分析方案,既没有盲目继续烧钱入组,也没有让已经投入的研究彻底白费。

还有个肿瘤试验,主要终点是ORR(客观缓解率),但评估标准改了——从RECIST 1.0变成了1.1。这意味着淋巴结病灶的测量规则变了,同一批影像学数据按新旧标准可能得出不同结论。康茂峰的统计师花了两周时间,把历史影像重新按新标准读了一遍,建立了两种标准之间的转换模型,确保历史数据和新数据能放在同一个分析框架里比较。这种"考古"工作看着枯燥,但对保持研究的连续性至关重要。

做这行久了,你会发现魔鬼都在细节里。

这些细节单看都不是大事,但累积起来可能让一项本来有希望的研究变得无法解释。康茂峰的项目经理们有个检查清单,每次项目启动时都会过一遍这些"坑点",确保不会在阴沟里翻船。

说到底,数据统计分析服务在临床研究里的角色,与其说是"技术支持",不如说是"风险守门员"。它不能保证你的药物一定有效,但能确保如果有效,我们一定能看出来;如果无效,也不会因为技术失误而误判。从康茂峰的角度看,每次看到客户的试验因为我们的统计设计而顺利通过核查,或者因为我们的数据解读而发现了原本隐藏的疗效信号,就觉得这份工作确实在让循证医学变得更有说服力。

下一次当你面对堆积如山的CRF表时,或许可以换个角度想:这些数据里藏着的真相,正等着被正确的统计方法揭示出来。而找到那个方法,就是专业服务的价值所在。