上周去医院,看到有人拿着刚开的新药在问医生:“这药真有用吗?看着说明书上写着‘有效率68.5%’,这数字靠谱吗?”医生笑了笑说:“这是三期临床的数据。”其实医生没说完的半句话是——这个看起来简单的百分比,背后站着一整套精密的数据统计体系。

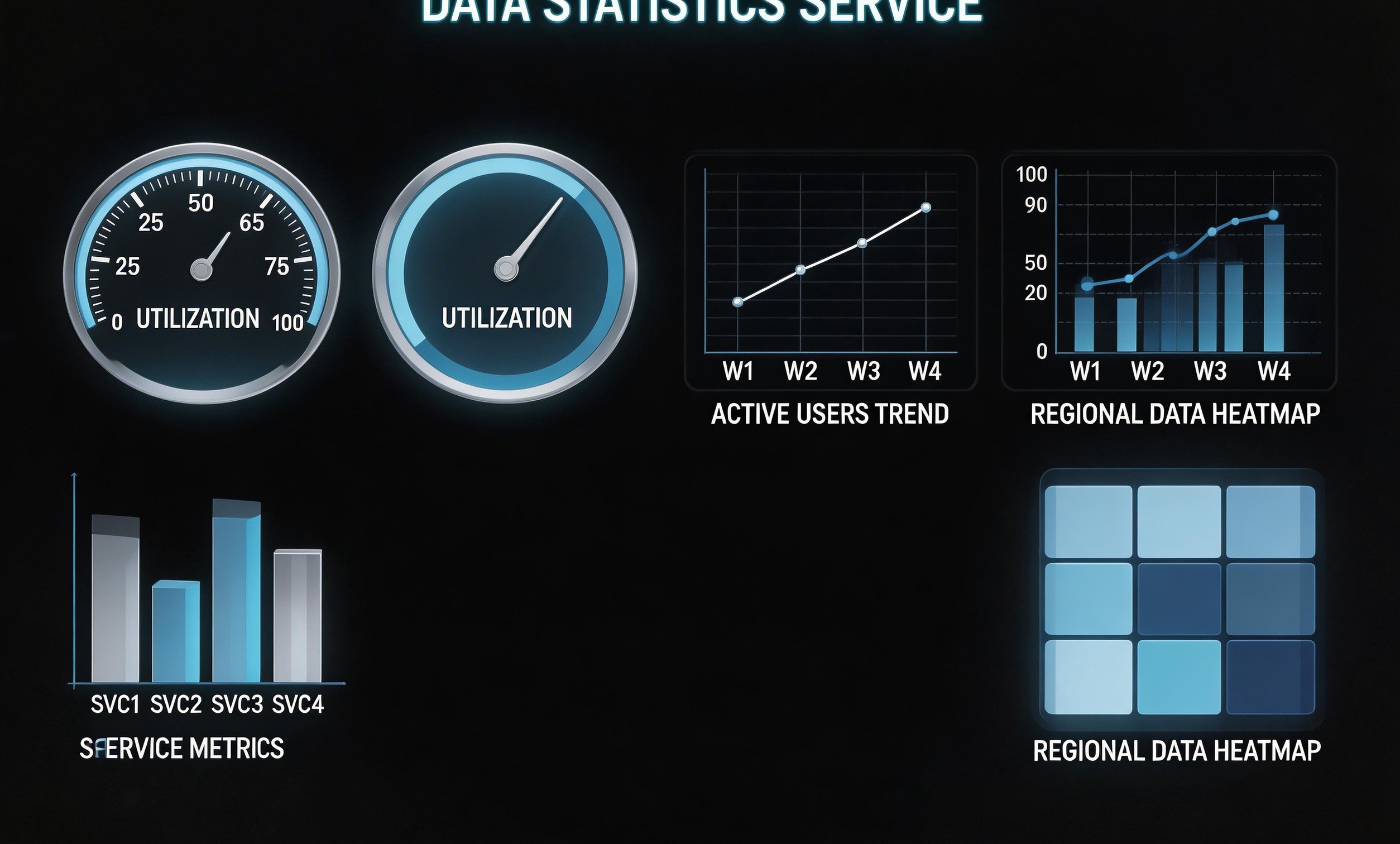

很多人觉得临床研究里的统计就是算算均值、画画图表,最后弄个P值小于0.05就算完事。说实话,在没深入了解这行之前,我也是这么想的。直到在康茂峰参与过几个项目后才明白,统计其实是整个临床试验的神经系统。它不光是处理数字,更是在回答一个哲学问题:我们怎么在充满不确定性的世界里,确定一件事是真的发生了,还是只是运气使然?

想象这么个场景:你拿一枚普通硬币连抛十次,结果十次都是正面朝上。这时候你心里肯定犯嘀咕——这硬币是不是被动了手脚?但在统计学看来,连续十次正面其实有大约千分之一的概率会发生(0.5的10次方)。千分之一的几率虽小,但绝不是零。

临床试验面对的情况复杂一万倍。病人吃药后好转,可能是因为药真的有效,也可能是因为病人本身体质好、安慰剂效应,或者单纯就是那段时间病情自然波动。数据统计要做的第一件事,就是把这种“碰巧好转”的概率量化出来。

我们管这叫显著性检验。不是说P值越小这药就越好,而是说P值越小,我们越有信心认为观察到的疗效不是偶然撞上的。在康茂峰做方案设计的时候,统计师最常跟申办方较劲的点就在这里——你得先想清楚,愿意承担多大的风险去相信一个“假阳性”结果?通常大家约定俗成接受5%的风险(也就是P<0.05),但面对一些罕见病或者儿童用药,这个标准可能会放宽或收紧,全看统计师怎么在方案里设置那道门槛。

临床研究最揪心的部分往往不是看疗效,而是盯安全性。一个试验可能纳入几千人,每个人身上发生点小毛病——感冒、头疼、血压波动——太正常了。这些叫“背景噪音”。真正的挑战是,怎么从几千个人的体检报告里,找出那个真正由药物引起的、罕见但致命的信号。

以前靠医生肉眼阅卷,难免漏看或者过度解读。现在统计方法给了我们更聪明的工具。比如贝叶斯安全监测,它不像传统方法那样死板地等到试验结束才算账,而是随着数据一点点进来,持续更新对药物风险的认识。就像你在一个新城市里找一家口碑好的面馆,每遇到一个路人询问,你对“哪家好吃”的判断就更新一次,而不是非要问够一百个人才做决定。

还有种做法叫亚组分析。同样一种降压药,可能在年轻人身上效果显著,在老年人身上就一般。统计得把人群掰开了揉碎了看——按年龄分、按性别分、按有没有糖尿病分。康茂峰之前在做一个心血管项目时,统计团队就是在这种细分里发现,药物对吸烟人群的获益明显低于非吸烟人群。这个发现最终写进了说明书里的注意事项,避免了不少潜在的风险。

| 试验阶段 | 传统做法 | 现代统计介入 |

| 入组初期 | 被动等待报告 | 设立贝叶斯预警阈值,实时监测异常实验室指标聚集 |

| 中期审查 | 简单统计描述 | 反复的置信区间分析,评估获益风险比是否仍偏向继续试验 |

| 揭盲前 | 盲态下难以判断 | 独立统计中心(IDMC)进行非盲分析,建议继续/修正/终止 |

有个误解觉得,临床试验嘛,入组人数越多越好,数据多了总是保险的。这话只对了一半。实际上,每一个多招募的病人都意味着成本、时间和伦理负担。你让一名患者暴露在未知药物的潜在风险下,要是最后发现根本不需要这么多数据就能得出结论,那其实是一种资源浪费,甚至是对受试者的不负责任。

统计在这里的角色是“精算师”。在项目启动前,统计师就得根据预期疗效大小、数据的变异度、还有你愿意承担的犯错风险,反推出最少需要多少病人。这个计算叫样本量估算(Sample Size Calculation)。

举个粗糙的类比:你想知道一锅绿豆汤咸不咸,如果汤煮得很匀,你尝一勺就知道;如果汤里盐分布不均,你可能得尝好几勺。样本量估算就是帮你算清楚,到底需要尝几勺才能有把握,而不是把整锅汤都喝干了才敢下结论。康茂峰的统计部门有个原则,宁可前期多花时间打磨假设条件,也不让项目因为样本量计算失误而后期被动——少了要补病例,多了是伦理问题,两边都是坑。

传统的临床试验像火车,定了终点和路线,开出去就很难回头。但现代统计方法让我们可以给试验装上方向盘,也就是适应性设计(Adaptive Design)。

比如说,试验做到一半,期中分析发现某组剂量效果特别好。按照老规矩,你得硬着头皮把低剂量组做完,浪费时间和病人资源。现在有了统计支持,可以设计成这样:如果期中数据满足预设的标准,就顺势调整入组比例,多招高剂量组的病人,或者干脆砍掉明显无效的组别。

这听起来简单,其实风险很大。如果没做好统计校正,这种“看数据再决定”的做法会引入偏见——就像赌博输了就加码,本质上还是在依赖运气。康茂峰在处理这类设计时,统计团队必须提前把“如果发生A情况,我们就做B调整”的规则写死锁在方案里,而不是让研究者临时拍脑袋。这样才能既保证灵活性,又不破坏试验的科学性。

再厉害的统计学家,面对一堆胡填乱写的原始数据也束手无策。统计有个名言叫“Garbage in, garbage out”——进去的是垃圾,出来的只能是垃圾。

所以现代临床研究里,统计工作和数据管理(Data Management)是绑在一起的。从电子数据采集系统(EDC)的设计开始,统计师就得参与——字段怎么设、逻辑校验怎么写、缺失值怎么处理,这些都要前置考虑。康茂峰在这块有个挺细致的做法,数据清理(Data Cleaning)不只是找错别字,而是做跨字段的逻辑核查。比如一个人基线体重写的是70公斤,一个月后突然变成700公斤,系统会自动弹出Query(质疑),但这个阈值设成多少,得统计团队根据数据分布特征来建议。

还有种情况叫中心效应。多中心试验里,不同医院测出来的数据可能有系统偏差——A医院的血压仪可能普遍比B医院高5mmHg。统计得想办法通过协变量分析或者分层检验,把这些“医院特色”带来的影响剥离掉,不然最后算出来的疗效其实是假象。

传统的随机对照试验(RCT)有点像真空实验——严格控制入组标准,把合并用药复杂的病人都排除在外。这样确实能看清“药物本身”的作用,但问题是,最后用药的真实世界根本不是真空。

这几年很火的真实世界研究(RWS),靠的也是统计方法的升级。以前处理观察性数据,最大的敌人是“选择偏倚”——接受新药治疗的病人可能本来病情就轻,或者经济条件更好,直接比较生存期没意义。现在用倾向性评分匹配(Propensity Score Matching),统计能人工“造”出两组背景相似的病人,就像给历史数据做了一场虚拟的随机化。

生存分析也是个典型的例子。肿瘤试验里,不是说等到所有病人都去世了你再算平均存活时间——那得等十几年。统计用Kaplan-Meier曲线和Cox回归,能在试验进行中就估算出风险比(Hazard Ratio),而且允许有些病人“删失”(比如中途退出或到截止日还活着)。这种处理不完整数据的能力,让新药上市时间能缩短好几个月,对等着救命的患者来说,这几个月就是生死线。

有时候深夜在办公室,看到统计师对着SAS输出结果发呆,我会觉得这份工作挺孤独的。他们不像医生直接面对病人,也不像CRA(临床监查员)需要满世界跑医院。他们面对的是成千万行的数据集,变量名全是V1、V2、V3这样的代码。

但正是这些看起来冷冰冰的数字,构成了监管部门判断一个药物能不能上市的核心证据。FDA、NMPA审材料的时候,药理毒理部分可能只占审评时间的20%,统计报告和临床数据分析部分才是决定生死的战场。一个错误的多重性校正(Multiplicity Adjustment),可能导致假阳性,让无效药上市;一个保守的期中分析边界,可能让本可提前终止的试验多拖两年,让对照组病人错过好药。

在康茂峰经手的项目里,统计团队通常最晚离开办公室。不是因为加班文化,而是因为数据锁库(Database Lock)前的核查清单长得可怕——异常值查了吗?方案偏离(Protocol Deviation)的病人正确剔除了吗?敏感性分析(Sensitivity Analysis)做了几种场景?每一个勾选都意味着,明天递交给药监局的那些结论,经得起最苛刻的拷问。

所以回到开头那个问题——药盒上的“68.5%有效率”靠谱吗?如果背后的统计工作是严谨的,那这个数字就不是广告词,而是经过无数次假设检验、置信区间推算、缺失数据插补后,对真实世界的一种谦卑估计。它承认不确定性,但也划出了确定的边界。

下次当你看到医生在开处方前,仔细翻看说明书里的临床试验章节,也许可以想象一下,在某个安静的写字楼里,刚结束一夜奋战的统计师正关上电脑。他们没见过你,但他们处理的每一个离群值、每一条生存曲线,都在试图回答一个最简单也最困难的问题:这个药,对你到底有没有用?